@本文来源于公众号:csdn2299,喜欢可以关注公众号 程序员学府 Apache Spark 是一个新兴的大数据处理通用引擎,提供了分布式的内存抽象。Spark 最大的特点就是快,可比 Hadoop MapReduce 的处理速度快 100 倍。本文没有使用一台电脑上构建多个虚拟机的方法来模拟集群,而是使用三台电脑来搭建一个小型分布式集群环境安装。 安装Hadoop并搭建好Hadoop集群环境 安装Spark 这里采用3台机器(节点)作为实例来演示如何搭建Spark集群,其中1台机器(节点)作为Master节点,另外两台机器(节点)作为Slave节点(即作为Worker节点),主机名分别为Slave01和Slave02。 配置环境变量 在Mster节点主机的终端中执行如下命令: 在.bashrc添加如下配置: 执行如下命令使得配置立即生效: Spark配置 配置slaves文件 slaves文件设置Worker节点。编辑slaves内容,把默认内容localhost替换成如下内容: 配置spark-env.sh文件 编辑spark-env.sh,添加如下内容: SPARK_MASTER_IP 指定 Spark 集群 Master 节点的 IP 地址; 配置好后,将Master主机上的/usr/local/spark文件夹复制到各个节点上。在Master主机上执行如下命令: 在slave01,slave02节点上分别执行下面同样的操作: 启动Spark集群 启动Spark集群 在Master节点上运行jps命令,可以看到多了个Master进程: 2.启动所有Slave节点 分别在slave01、slave02节点上运行jps命令,可以看到多了个Worker进程 3.在浏览器上查看Spark独立集群管理器的集群信息 2.关闭Worker节点 3.关闭Hadoop集群 非常感谢你的阅读 其实这里不仅有技术,更有那些技术之外的东西,比如,如何做一个精致的程序员,而不是“屌丝”,程序员本身就是高贵的一种存在啊,难道不是吗?[点击加入]

这篇文章主要介绍了Spark分布式集群环境搭建基于Python版,Apache Spark 是一个新兴的大数据处理通用引擎,提供了分布式的内存抽象。100 倍本文而是使用三台电脑来搭建一个小型分布式集群环境安装,需要的朋友可以参考下

前言

本教程采用Spark2.0以上版本(比如Spark2.0.2、Spark2.1.0等)搭建集群,同样适用于搭建Spark1.6.2集群。

Spark分布式集群的安装环境,需要事先配置好Hadoop的分布式集群环境。

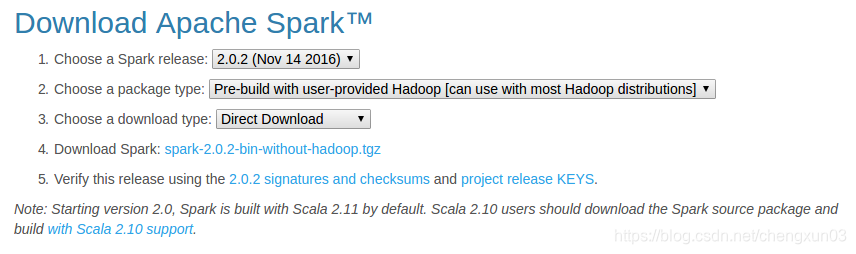

在Master节点机器上,访问Spark官方下载地址,按照如下图下载。

下载完成后,执行如下命令:sudo tar -zxf ~/下载/spark-2.0.2-bin-without-hadoop.tgz -C /usr/local/ cd /usr/local sudo mv ./spark-2.0.2-bin-without-hadoop/ ./spark sudo chown -R hadoop ./spark vim ~/.bashrc export SPARK_HOME=/usr/local/spark export PATH=$PATH:$SPARK_HOME/bin:$SPARK_HOME/sbin source ~/.bashrc

在Master节点主机上进行如下操作:

将 slaves.template 拷贝到 slavescd /usr/local/spark/ cp ./conf/slaves.template ./conf/slaves slave01 slave02

将 spark-env.sh.template 拷贝到 spark-env.shcp ./conf/spark-env.sh.template ./conf/spark-env.sh export SPARK_DIST_CLASSPATH=$(/usr/local/hadoop/bin/hadoop classpath) export HADOOP_CONF_DIR=/usr/local/hadoop/etc/hadoop export SPARK_MASTER_IP=192.168.1.104 cd /usr/local/ tar -zcf ~/spark.master.tar.gz ./spark cd ~ scp ./spark.master.tar.gz slave01:/home/hadoop scp ./spark.master.tar.gz slave02:/home/hadoop sudo rm -rf /usr/local/spark/ sudo tar -zxf ~/spark.master.tar.gz -C /usr/local sudo chown -R hadoop /usr/local/spark

启动Hadoop集群

启动Spark集群前,要先启动Hadoop集群。在Master节点主机上运行如下命令:cd /usr/local/hadoop/ sbin/start-all.sh

1.启动Master节点

在Master节点主机上运行如下命令:cd /usr/local/spark/ sbin/start-master.sh 15093 Jps 14343 SecondaryNameNode 14121 NameNode 14891 Master 14509 ResourceManager

在Master节点主机上运行如下命令:sbin/start-slaves.sh 37553 DataNode 37684 NodeManager 37876 Worker 37924 Jps

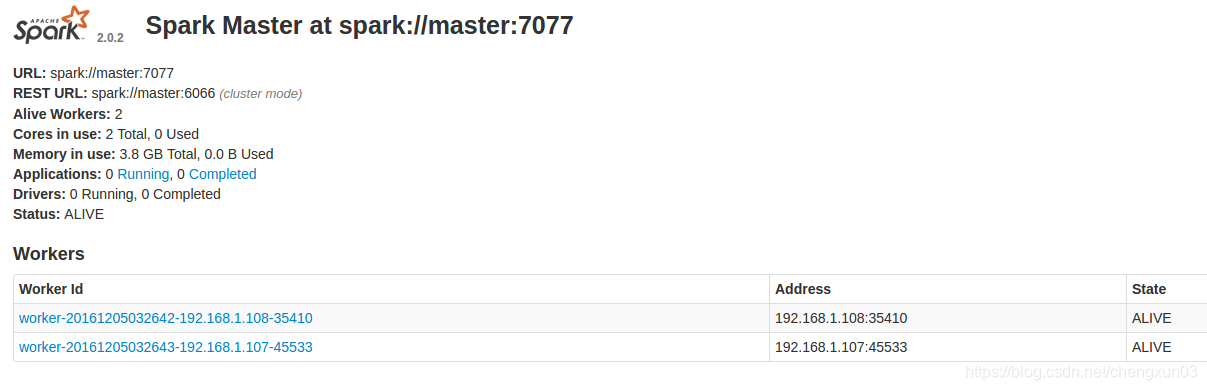

在master主机上打开浏览器,访问https://master:8080,如下图:

关闭Spark集群

1.关闭Master节点sbin/stop-master.sh sbin/stop-slaves.sh cd /usr/local/hadoop/ sbin/stop-all.sh

大学的时候选择了自学python,工作了发现吃了计算机基础不好的亏,学历不行这是没办法的事,只能后天弥补,于是在编码之外开启了自己的逆袭之路,不断的学习python核心知识,深入的研习计算机基础知识,整理好了,我放在我们的微信公众号《程序员学府》,如果你也不甘平庸,那就与我一起在编码之外,不断成长吧!

想做你自己想成为高尚人,加油!

本网页所有视频内容由 imoviebox边看边下-网页视频下载, iurlBox网页地址收藏管理器 下载并得到。

ImovieBox网页视频下载器 下载地址: ImovieBox网页视频下载器-最新版本下载

本文章由: imapbox邮箱云存储,邮箱网盘,ImageBox 图片批量下载器,网页图片批量下载专家,网页图片批量下载器,获取到文章图片,imoviebox网页视频批量下载器,下载视频内容,为您提供.

阅读和此文章类似的: 全球云计算

官方软件产品操作指南 (170)

官方软件产品操作指南 (170)